机器阅读理解中文章和问题的深度学习表示方法

/* 版权声明:可以任意转载,转载时请标明文章原始出处和作者信息 .*/

author: 张俊林

注:本文是《深度学习解决机器浏览理解任务的研究进展》节选,该文将于近期在“深度学习大讲堂”公众号发布。

2.1文章和问题的表示方法

用神经网络处理机器浏览理解问题,首先面临的问题就是如何表示文章和问题这两个最重要的研究对象。我们可以从现有机器浏览理解相干文献中归纳总结出经常使用的表示方法,固然这些表示方法不单单局限于浏览理解问题,也常常见于NLP其他子领域中。

图4.文档表示方法:模型1

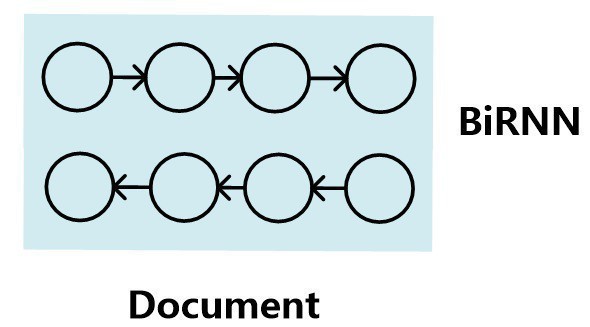

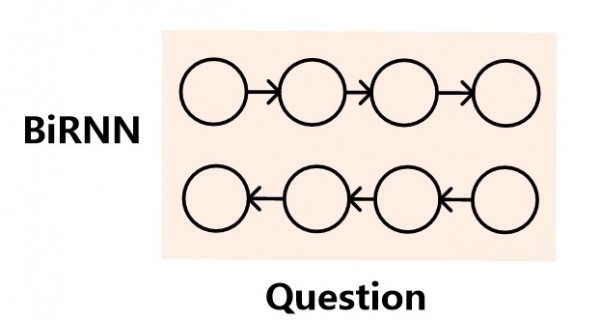

首先,对机器浏览理解中的文章来讲,有两种常见的文章内容表达方式。最多见的1种即是将1篇文章看成有序的单词流序列(参考图4的模型1),在这个有序序列上使用RNN来对文章进行建模表达,每一个单词Dt对应RNN序列中的1个时间步t的输入,RNN的隐层状态Ht代表融会了Dt本身词义和其上下文语义的语言编码。这类表示方法其实不对文章整体语义进行编码,而是对每一个单词及其上下文语义进行编码,在实际使用的时候是使用每一个单词的RNN隐层状态Ht来进行相干计算。至于具体的RNN模型,常见的有标准RNN、LSTM、GRU及其对应的双向版本等。对机器浏览理解来讲双向RNN是最经常使用的表示方法,1般每一个单词的语义表示由正向RNN隐层状态和反向RNN隐层状态拼接来表示,即:

模型1常常在机器浏览理解系统的原始输入部份对文章进行表征,由于对很多浏览理解任务来讲,本质上是从文章中推导出某个几率最大的单词作为问题的答案,所以对文章以单词的情势来表征非常自然。

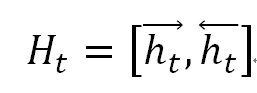

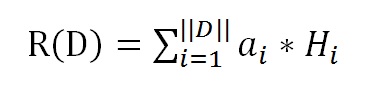

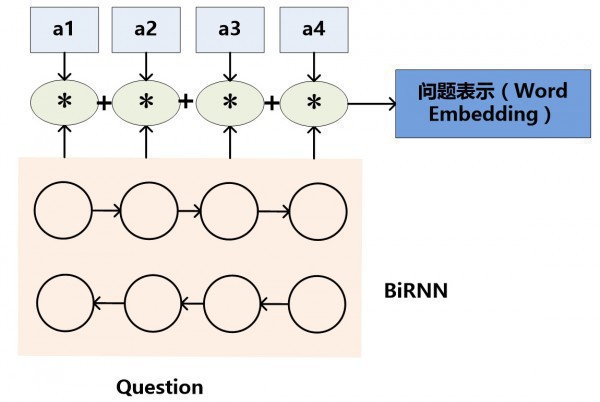

另外1种常见的文章内容表达方式则是从每一个单词的语义表达推导出文章整体的Word Embedding表达,这类情势常常是在对问题和文章进行推理的内部进程中使用的表达方式。典型的表达进程如图5所示的模型2所示。

图5. 文档表示方法:模型2

对机器浏览理解中的问题来讲,有3种常见的语义表达方式。如果将查询看做1种特殊的文章的话,很明显文章的语义表达方式一样可以用来表征问题的语义,也就是类似于文档表示方法的模型1和模型2,除另外,还有另外1种不同的表达方式。问题的表示方法模型1如图6所示,模型2如图7所示,其代表的含义与文章表征方式类似,所以此处不赘述。

图6.问题表示方式:模型1

图7.问题表示方法:模型2

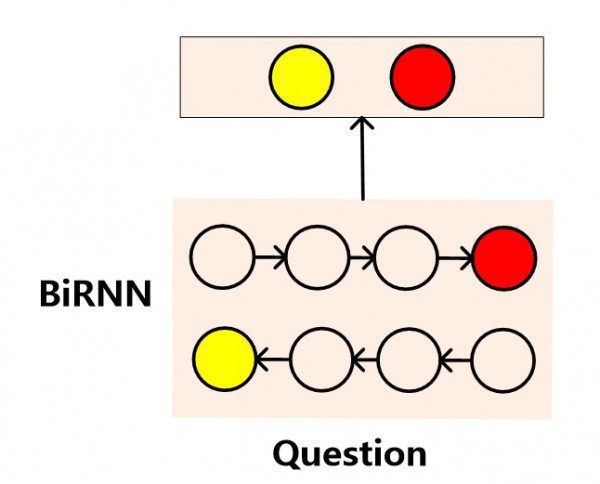

问题表示方法的另外1种表示如图8所示,我们可以称之为模型3。

图8.问题表示方法:模型3

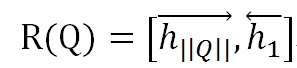

模型3也是在模型1的基础之上的改进模型,也是NLP任务中表达句子语义的最多见的表达方式。首先类似于模型1,使用双向RNN来表征每一个单词及其上下文的语义信息。对正向RNN来讲,其尾部单词(句尾词)RNN隐层节点代表了融会了全部句子语义的信息;而反向RNN的头部单词(句首词)则逆向融会了全部句子的语义信息,将这两个时刻RNN节点的隐层状态拼接起来则可以表征问题的整体语义:

理论上模型3也能够用来表征文章的语义信息,但是1般不会这么用,主要缘由是文章常常都比较长,RNN对太长的内容表征能力不足,所以类似模型3的方法会存在大量的信息丢失,而“问题”1般来讲都是比较短的1句话,所以用模型3表征是比较适合的。

以上介绍的几个模型是在机器浏览理解领域里经常使用的表征文章和问题的表示方法。下面我们从机器浏览理解神经网络结构的角度来进行经常使用模型的介绍。

扫1扫关注微信号:“布洛卡区” ,深度学习在自然语言处理等智能利用的技术研讨与科普公众号。

扫1扫关注微信号:“布洛卡区” ,深度学习在自然语言处理等智能利用的技术研讨与科普公众号。