复习机器学习算法:Boosting

栏目:php教程时间:2015-03-24 08:13:07

Boosting的思想是集成学习,把许多个弱分类器结合起来,构成1个强分类器。

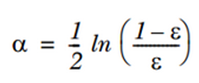

首先输入原始的训练样本,得到1个弱分类器,可以知道它的正确率和毛病率。计算该弱分类器的权重,以下:

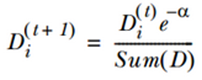

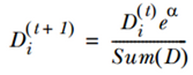

然后提高毛病分类样本的权重,让后面的分类器focus它们,调剂样本的权重:

如果本来分类正确:

如果样本分类毛病:

把新的样本输入到后面学习,重复这个进程,得到许多个弱分类器,及其分类器的权重。

注意,Boosting算法中有两个权重,1个是分类器的权重,1个是样本的权重。

Boosting算法的优点:性能好,可以避免过拟合,可以综合多个分类器的优势。

缺点:对离群点比较敏感。

------分隔线----------------------------

------分隔线----------------------------